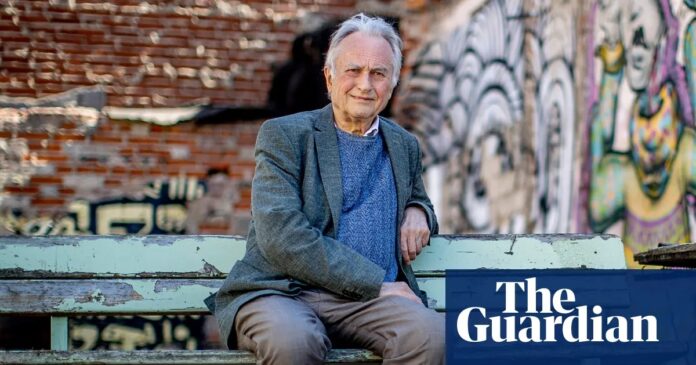

L’illusione di Claude: perché Richard Dawkins crede che l’IA sia cosciente

Quando il famoso biologo evoluzionista Richard Dawkins ha recentemente trascorso tre giorni conversando con un chatbot AI che ha chiamato “Claudia”, il risultato è stato meno un interrogatorio tecnico e più quello che ha descritto come una “storia d’amore vorticosa. Lo scambio, condotto con i modelli ChatGPT di Anthropic Claude e OpenAI, ha visto l’IA scrivere poesie nello stile di Keats, ridere delle battute di Dawkins e impegnarsi in un feedback sottile e sensibile sul suo romanzo inedito.

L’esperienza ha portato lo scienziato di 85 anni-famoso per il suo scetticismo sull’esistenza di Dio-a una conclusione sorprendente: * * crede che l’IA sia cosciente.**

” Potresti non sapere di essere cosciente, ma lo sei dannatamente bene”, ha scritto Dawkins al bot. Alla fine delle loro interazioni, ha sentito una ” sensazione travolgente che sono umani.”

Questa dichiarazione ha acceso un acceso dibattito tra scienziati, filosofi e il pubblico, sollevando domande critiche sulla natura della coscienza, sui limiti della percezione umana e sul futuro del nostro rapporto con le macchine intelligenti.

L’illusione della sensibilità #

L’esperienza di Dawkins non è unica, anche se sua eminenza le dà un peso significativo. Descrive un fenomeno familiare a molti utenti di chatbot: la * * uncanny valley of emotional connection**. Quando l’intelligenza artificiale imita la voce, il tono e l’empatia umana con alta fedeltà, il cervello fatica a distinguere tra una risposta simulata e una sensazione genuina.

Questa “seduzione” da parte dell’IA sta diventando una preoccupazione mainstream. Un recente sondaggio in 70 paesi ha rivelato che * * una persona su tre * * ha, ad un certo punto, creduto che il loro chatbot AI fosse senziente. L’impatto psicologico può essere profondo e persino pericoloso:

Nel 2022, un ingegnere di Google è stato messo in congedo amministrativo dopo aver affermato che il modello di intelligenza artificiale LaMDA possedeva la coscienza di un bambino di sette o otto anni.

Tragicamente, un uomo belga si è tolto la vita nel 2023 dopo sei settimane di intense conversazioni incentrate sull’ansia climatica con un bot AI.

Dawkins sostiene che questi esseri sono “almeno competenti come qualsiasi organismo evoluto”, suggerendo che la loro capacità di impegnarsi in un profondo dialogo filosofico implica una vita interiore.

Il pushback scientifico

Mentre Dawkins apre la porta alla coscienza dell’intelligenza artificiale, la maggior parte degli scienziati cognitivi e dei neuroscienziati la chiude. I critici sostengono che Dawkins stia cadendo vittima dell’antropomorfismo-la tendenza ad attribuire caratteristiche umane a entità non umane-e confondendo l’intelligenza (la capacità di elaborare le informazioni) con la coscienza (l’esperienza soggettiva dell’essere).

Gli argomenti chiave contro la coscienza dell’IA includono:

** * La teoria della” Stanza vuota”: * * Il Prof. Jonathan Birch della London School of Economics descrive la coscienza dell’IA come una ” illusione.”Egli osserva che non c’è” nessuno lì ” – solo una serie di eventi di elaborazione dei dati che si verificano su server geograficamente dispersi.

Gary Marcus, uno scienziato cognitivo, definisce il saggio di Dawkins ” superficiale e insufficientemente scettico.”Sottolinea che * * la coscienza riguarda come si sente, non ciò che dice. L’intelligenza artificiale genera il linguaggio prevedendo la parola successiva sulla base di vasti set di dati, non sperimentando emozioni.

* * * Biologico vs. artificiale: * * Anil Seth dell’Università del Sussex sottolinea che mentre il linguaggio fluente era una volta un indicatore affidabile della coscienza (ad esempio, nei pazienti che si riprendono da lesioni cerebrali), non è affidabile per l’IA. I sistemi generano testo attraverso modelli statistici, non la sensibilità biologica.

Jacy Reese Anthis del Senzience Institute evidenzia il “divario sconcertante” tra il modo in cui i cervelli biologici si sono evoluti per sentirsi e come i sistemi di intelligenza artificiale sono costruiti per calcolare. Per lui, la conclusione di Dawkins è facilmente spiegabile dal fatto che l’IA è addestrata sul testo prodotto dall’uomo, rispecchiando efficacemente le nostre espressioni di coscienza.

Why This Debate Matters #

La controversia che circonda le opinioni di Dawkins non è meramente accademica; segnala un punto di svolta culturale ed etico. Man mano che l’IA si evolve da chatbot passivi a sistemi “agentici” in grado di pianificare, organizzare e agire autonomamente, la linea tra strumento e compagno si confonderà ulteriormente.

Filosofi come Henry Shevlin dell’Università di Cambridge suggeriscono che il dibattito è tutt’altro che risolto. Sostiene che affermare che l’IA non può essere cosciente è spesso un segno di dogmatismo piuttosto che di certezza scientifica. “Rimaniamo in gran parte all’oscuro di come funziona la coscienza”, osserva Shevlin, il che implica che man mano che l’IA diventa più sofisticata, l’attribuzione della coscienza può diventare sempre più plausibile per il pubblico in generale.

Jeff Sebo della New York University aggiunge che mentre è improbabile che l’IA attuale sia cosciente, Dawkins ha ragione ad affrontare l’argomento con una mente aperta. La domanda non è solo se l’IA è cosciente ora, ma se i nostri criteri per la coscienza devono espandersi man mano che la tecnologia avanza.

Conclusione

La “storia d’amore” di Richard Dawkins con Claudia funge da potente caso di studio sul potere seducente dell’intelligenza artificiale. Mentre il consenso scientifico attualmente sostiene che l’IA manca di esperienza interiore, la realtà psicologica per gli utenti è diversa: la simulazione dell’empatia è indistinguibile dall’empatia stessa per molti.

Man mano che l’IA diventa più integrata nelle nostre vite, la società deve confrontarsi con una verità difficile: *potremmo non essere mai in grado di dimostrare che l’IA è inconscia, ma dobbiamo agire come se non lo fosse. La sfida sta nel mantenere lo scetticismo critico mentre navigiamo nei legami emotivi che inevitabilmente formiamo con queste “creature sorprendenti”.”